Stanford a conçu des lunettes AR holographiques !

Alban Martin

Alban Martin- Il y a 2 ans

- 💬 2 coms

- 🔈 Écouter

![]() Une équipe de chercheurs de la prestigieuse université e Stanford développe une nouvelle technologie d'imagerie holographique assistée par l'intelligence artificielle plus que prometteuse. Plus fine, plus légère et de meilleure qualité que tout ce qu'on connait à date, cette technologie pourrait bien être le "game changer" des casques et surtout lunettes de réalité augmentée. Les Apple Glass pourraient (devraient) s'en inspirer.

Une équipe de chercheurs de la prestigieuse université e Stanford développe une nouvelle technologie d'imagerie holographique assistée par l'intelligence artificielle plus que prometteuse. Plus fine, plus légère et de meilleure qualité que tout ce qu'on connait à date, cette technologie pourrait bien être le "game changer" des casques et surtout lunettes de réalité augmentée. Les Apple Glass pourraient (devraient) s'en inspirer.

Un espoir pour le futur de la technologie

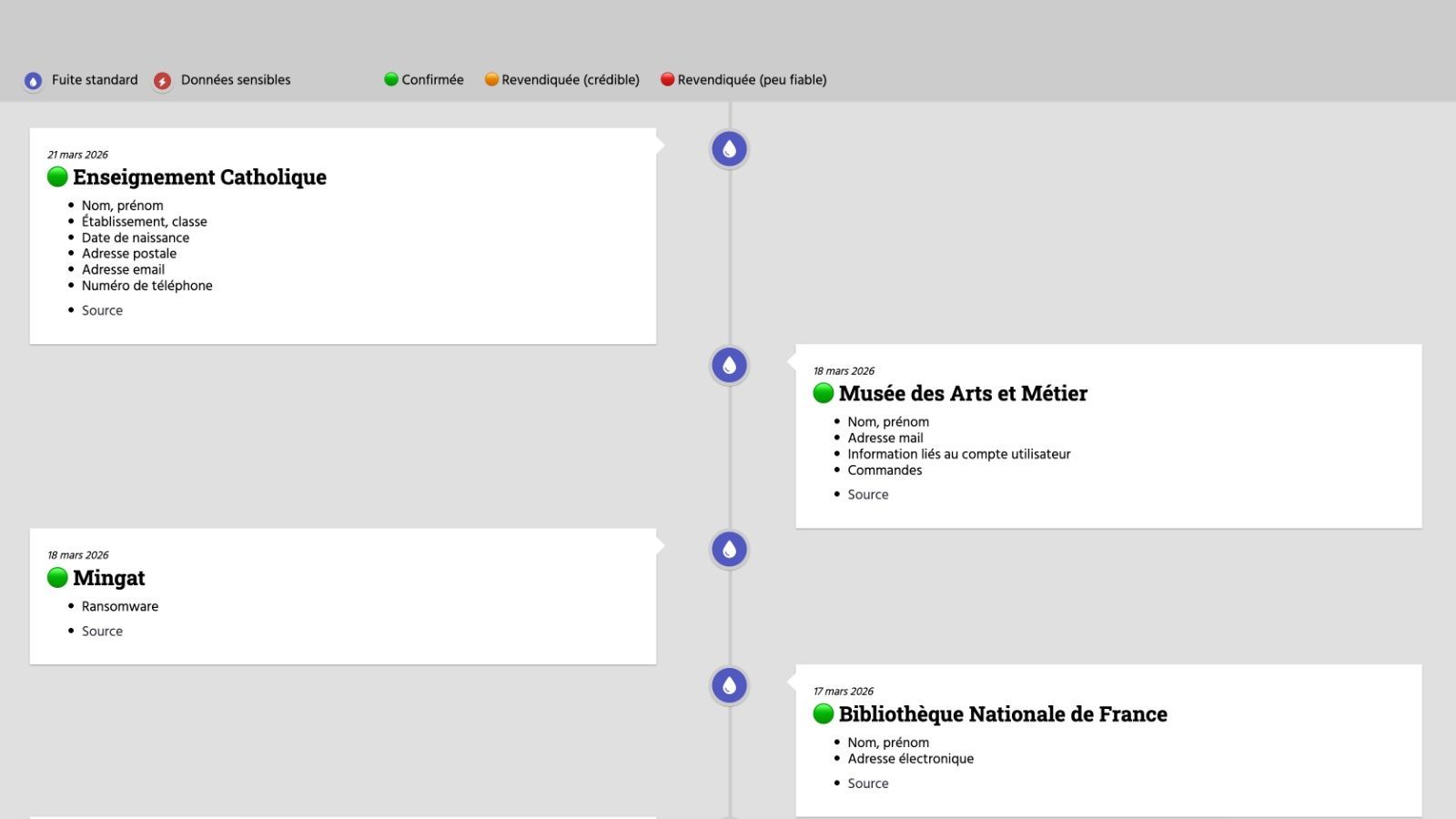

S'il ne faut pas s'emballer trop vite, la version de laboratoire ayant un champ de vision anémique - seulement 11,7 degrés, bien plus petit qu'un Vision Pro, Magic Leap et autre HoloLens, il s'agit d'une avancée majeure.

En effet, le Computational Imaging Lab de Stanford dispose d'une page entière d'aides visuelles qui suggèrent qu'il pourrait être sur quelque chose de spécial : une pile plus fine de composants holographiques qui pourrait presque entrer dans des montures de lunettes standard et être entraînée à projeter des images 3D réalistes, en couleur et en mouvement, avec une prise en compte de la profondeur. À comparer avec le condensé de technologies d'un "gros" Vision Pro.

Prototype de lunettes AR Glass. Image © Stanford

Pour produire des images 3D plus satisfaisantes, Gordon Wetzstein a fait l'impasse sur les approches stéréoscopiques traditionnelles en faveur de l'holographie, une technique visuelle récompensée par un prix Nobel et développée à la fin des années 1940. Bien que l'imagerie 3D soit très prometteuse, l'adoption plus généralisée de l'holographie a été limitée par l'incapacité de représenter des indices de profondeur 3D précis, ce qui a conduit à une expérience visuelle décevante, pour ne pas dire plus.

Comme les autres lunettes de réalité augmentée, elles utilisent des guides d'ondes, un composant qui conduit la lumière à travers les lunettes et dans les yeux du porteur. Les chercheurs affirment avoir mis au point un « méta-guide de surface nanophotonique » unique qui peut « éliminer le besoin d'optiques de collimation encombrantes », ainsi qu'un « modèle de guide d'onde physique appris » qui utilise des algorithmes d'IA pour améliorer considérablement la qualité de l'image. C'est là la clé du projet.

L'étude précise que les modèles « sont automatiquement calibrés à l'aide du retour d'information de la caméra ».

Notre casque apparaît au monde extérieur comme une paire de lunettes ordinaire, mais ce que le porteur voit à travers les lentilles est un monde enrichi superposé d'images 3D calculées, vibrantes et en couleurs.

Comparaison de l'optique des lunettes AR existantes et du prototype. Image © Stanford

Bien que ce ne soit encore qu'un prototype, avec un tas d'appareils autour pour "nourrir" les lunettes, les chercheurs ont de quoi perturber le marché actuel de l'informatique spatiale, qui comprend également des casques de réalité mixte encombrants comme le Vision Pro d'Apple, le Quest 3 de Meta, et d'autres.

Gun-Yeal Lee, chercheur postdoctoral, qui a participé à la rédaction de l'article publié dans Nature, assure qu'il n'existe aucun autre système de réalité augmentée comparable en termes de capacité et de compacité. Il ne faut pas avoir fait Polytechnique pour le comprendre.

La réponse attendue des géants

Des entreprises comme Meta ou Apple ont dépensé des milliards pour acheter et développer la technologie des lunettes de réalité augmentée, dans l'espoir de produire un jour un produit de la taille et de la forme de lunettes normales. Actuellement, les Ray-Ban de Meta n'ont pas d'écran intégré, mais vise 2027 pour un premier modèle tout-en-un. Mais surtout, cela nous donne de l'espoir quant à des Apple Glass largement plus portables que le Vision Pro actuel...

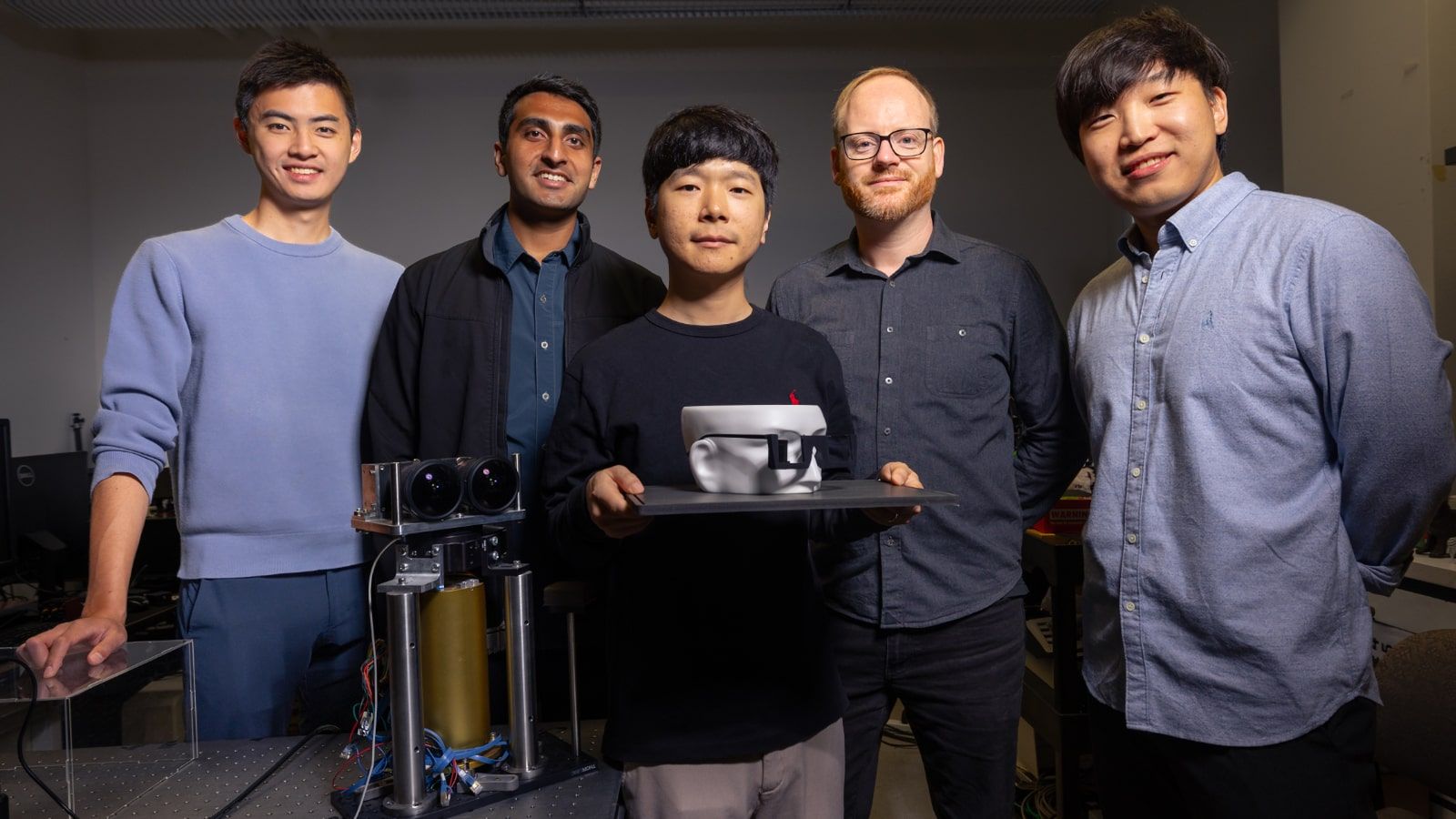

L'équipe de chercheurs du projet AR Glass de Stanford. Image © Stanford