L'Allemagne demande à Tim Cook de revoir ses outils CSAM

Alban Martin

Alban Martin- Il y a 5 ans (Màj il y a 3 ans)

- 💬 2 coms

- 🔈 Écouter

![]() Depuis qu'Apple a présenté la nouvelle fonction d'analyse CSAM pour protéger les enfants des photos pornographiques, l'annonce a suscité de nombreuses inquiétudes et controverses concernant la confidentialité des utilisateurs. Cette fois, c'est le chef de la commission de l'agenda numérique du parlement allemand qui demande à Apple de reconsidérer ses plans dans une lettre à Tim Cook.

Depuis qu'Apple a présenté la nouvelle fonction d'analyse CSAM pour protéger les enfants des photos pornographiques, l'annonce a suscité de nombreuses inquiétudes et controverses concernant la confidentialité des utilisateurs. Cette fois, c'est le chef de la commission de l'agenda numérique du parlement allemand qui demande à Apple de reconsidérer ses plans dans une lettre à Tim Cook.

Cette fois c'est l'Allemagne qui s'inquiète d'une dérive potentielle

Tel que rapporté par Heise Online, Manuel Hoferlin, président du comité de l'Agenda numérique, pense qu'Apple s'engage sur une « voie dangereuse » tout en sapant « une communication sûre et confidentielle ». C'est peu ou prou ce que disait certains experts.

Bien que l'analyse CSAM ne soit disponible qu'aux États-Unis lors de son lancement, Hoferlin affirme que ce sera "le plus grand instrument de surveillance de l'histoire" et pourrait faire perdre à Apple l'accès à de grands marchés si la société venait à maintenir cette stratégie.

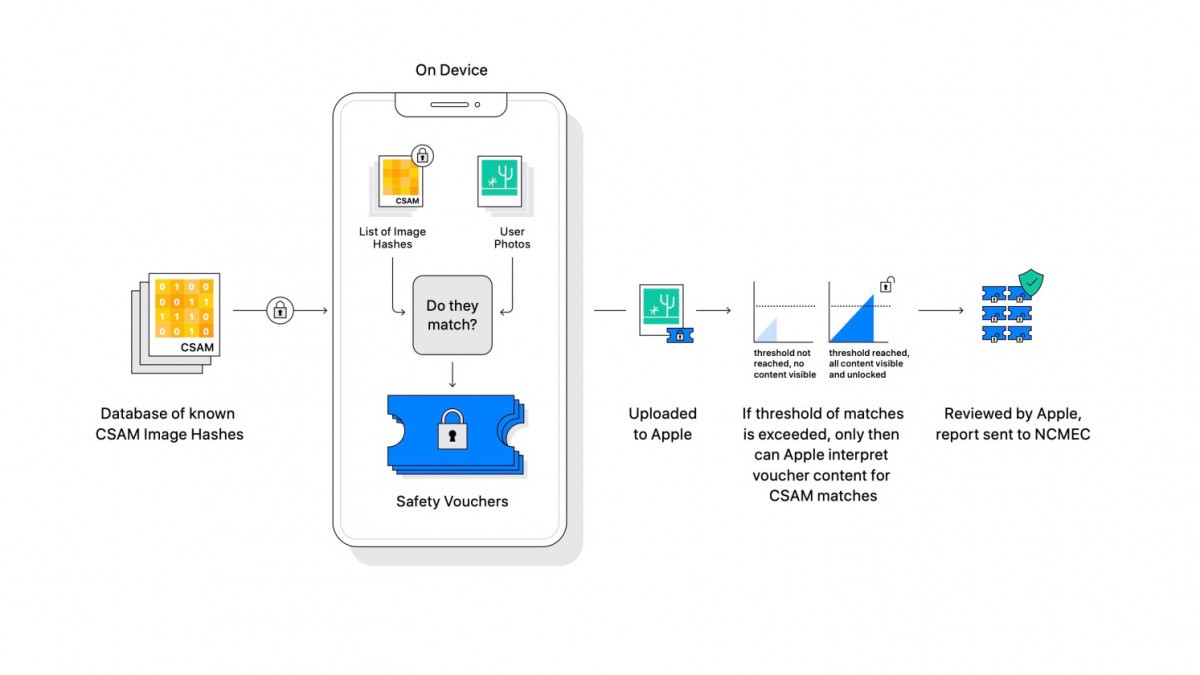

Apple, de son côté, a tenté d'expliquer que l'analyse CSAM ne va pas analyser les photos de chaque personne sur son iPhone. En plus de cela, la société a annoncé la semaine dernière que le système pourra être audité et utilisé par des tiers.

Apple a expliqué qu'il publiera le hachage racine de la base de données CSAM cryptée. Apple permettra également aux utilisateurs d'inspecter la base de données sur leur appareil et de la comparer à celle dans l'article de la base de connaissances.

En dehors de cela, la société continue d'expliquer son engagement et sa mise en place. Après un document détaillé sur les questions fréquemment posées publié la semaine dernière, Apple a également détaillé le fonctionnement en précisant que la détection CSAM ne s'appliquerait qu'aux photos stockées dans iCloud Photos, pas aux viéos. Du coup, si un utilisateur n'utilise pas iCloud Photos, aucune partie du processus de détection CSAM ne s'exécute.

Apple affirme que l'implémentation de la détection CSAM sur l'appareil est bien meilleure que les implémentations côté serveur utilisées par d'autres sociétés. Ces implémentations, explique Apple, nécessitent qu'une entreprise numérise chaque photo stockée par un utilisateur sur son serveur, dont la majorité ne sont pas CSAM.

Une chose est sûre, nous n'avons pas fini d'entendre parler de cette initiative qui arrivera plus tard avec iOS 15 et macOS 12. Pour le moment, la bourse ne réagit pas et l'action AAPL tourne toujours autour des 150$.

Apple détaille la sécurité de ses outils CSAM

Apple détaille la sécurité de ses outils CSAM![[Live] Keynote WWDC 26 d'Apple du 08/06 : iOS 27, macOS 27, watchOS 27, tvOS 27](/images/2026/03/wwdc26-halo.jpg)