Apple va nous protéger de l'IA promet Craig Federighi

William Teixeira

William Teixeira- Il y a 3 ans (Màj il y a 3 ans)

- 💬 1 com

- 🔈 Écouter

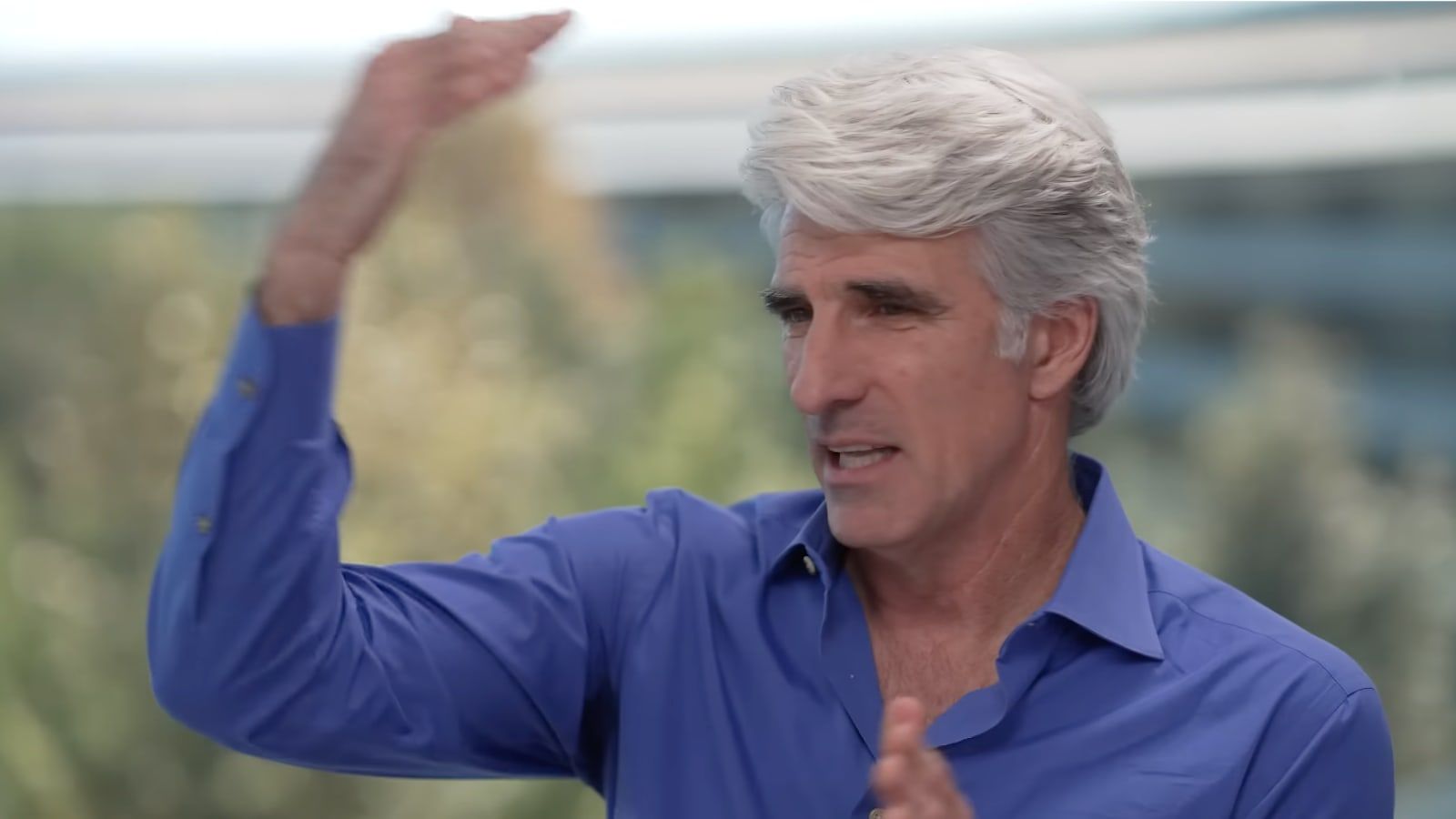

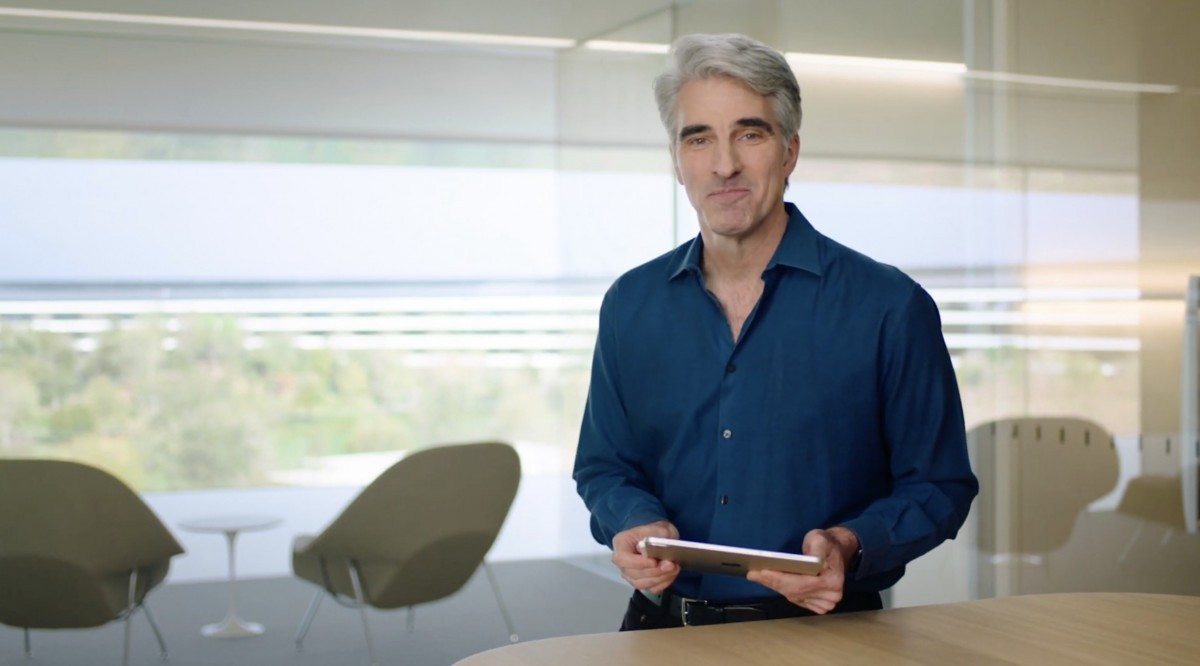

![]() Suite à l'Apple Event d'ouverture de la WWDC 2023 qui a eu lieu hier, Craig Federighi, le responsable des logiciels chez Apple a accordé une interview exclusive au média FastCompany. Au-delà du résumé de toutes les annonces qui ont été faites et des axes majeurs pris par Apple pour la confidentialité, Federighi a abordé un sujet sensible : les problèmes que peut générer l'intelligence artificielle en ce qui concerne la sécurité et les fausses informations.

Suite à l'Apple Event d'ouverture de la WWDC 2023 qui a eu lieu hier, Craig Federighi, le responsable des logiciels chez Apple a accordé une interview exclusive au média FastCompany. Au-delà du résumé de toutes les annonces qui ont été faites et des axes majeurs pris par Apple pour la confidentialité, Federighi a abordé un sujet sensible : les problèmes que peut générer l'intelligence artificielle en ce qui concerne la sécurité et les fausses informations.

Craig Federighi le promet, Apple va devenir un atout majeur dans l'avenir contre les IA malintentionnées

Aujourd'hui, l'intelligence artificielle est vue comme quelque chose de révolutionnaire, capable d'améliorer le quotidien, de remplacer des recherches sur un moteur de recherche, d'avancer plus vite sur des projets professionnels... Toutefois, l'évolution majeure que l'on connaît avec l'intelligence artificielle en 2023, ChatGPT en tête, n'apporte pas que de bonnes choses. En effet, des groupes spécialisés dans le piratage utilisent déjà en masse l'intelligence artificielle pour détecter plus rapidement les failles dans des logiciels ou des systèmes d'exploitation.

L'IA est aussi néfaste pour tout ce qui est fake news. Aujourd'hui, il est possible de reproduire la voix de quelqu'un grâce à un simple échantillon de sa voix trouvé sur internet, de produire des images imaginaires ou même de créer des deepfakes : de fausses vidéos de célébrités ou de personnalités politiques afin de leur faire dire ce que l'on veut face à une caméra. Les résultats sont parfois bluffants et peuvent provoquer une confusion dans l'esprit des internautes qui tombent dessus.

Les promesses d'Apple

Face à cette tendance croissante de l'utilisation de l'IA dans le piratage et la propagation de fake news sur les réseaux sociaux, le responsable des logiciels d'Apple a assuré que cela va bientôt changer. En effet, Apple prévoit des stratégies pour contrer les IA qui sont utilisés pour détecter des vulnérabilités dans du code et même les IA qui ont pour mission de créer de fausses vidéos afin d'induire en erreur.

En ce qui concerne les IA utilisées dans le domaine du piratage, Craig Federighi a déclaré qu'Apple va dans peu de temps combattre le feu par le feu. Autrement dit, l'entreprise utilisera, elle aussi, de l'intelligence artificielle pour contrer de potentielles IA capables d’identifier des vulnérabilités dans iOS, iPadOS, macOS...

Apple utilise déjà un certain nombre d'outils d'analyse statique et dynamique pour aider l'entreprise à repérer les défauts de code potentiels qui peuvent être difficiles à détecter pour un humain. « Au mesure que ces outils deviennent de plus en plus avancés avec l'IA, nous serons à l'avant-garde de l'utilisation de ces outils pour trouver des problèmes et les fermer avant que les attaquants qui pourraient avoir accès à des outils similaires ne puissent les utiliser.

En ce qui concerne les deepfakes et les imitations de voix, Apple veut là aussi agir. Le responsable des logiciels d'Apple admet tout de fois que c'est compliqué de détecter un deepfake, plus le temps passe et plus, ils se perfectionnent. Toutefois, l'entreprise pense déjà à ces dangers et souhaite dans un avenir proche apporter une solution dans son écosystème pour déceler les potentiels deepfake.

Federighi parle dans l'interview de l'imitation de la voix d'un proche :

Lorsque quelqu'un pourra imiter la voix de votre compagne, il sera de plus en plus difficile de repérer les attaques d'ingénierie sociale. Si quelqu'un vous demande "Oh, peux-tu me donner le mot de passe de ceci et de cela ? Je suis bloqué à l'extérieur", et que cette personne ressemble littéralement à votre conjoint, je pense qu'il s'agira d'une véritable menace.

L'une des pistes pour révéler ces contrefaçons pourrait être l'authentification de l'appareil entre deux personnes qui se parlent par iMessage ou par FaceTime audio. C'est en tout cas l'une des éventualités évoquées par Craig Federighi. Évidemment, cela ne concernera pas les deepfakes que vous pouvez voir sur internet ou sur les réseaux sociaux, il va falloir pousser les idées un peu plus loin pour les détecter et les signaler aux utilisateurs de produits Apple.