OpenAI dévoile "Sora" : une IA texte-vidéo impressionnante ! (màj : disponible dans l'UE)

Alban Martin

Alban Martin- Il y a 2 ans (Màj il y a 1 an)

- 💬 13 coms

- 🔈 Écouter

![]() Cette nuit, OpenAI, la société derrière ChatGPT, a dévoilé Sora, un modèle texte-vidéo conçu pour simuler le monde physique en mouvement à partir d'une phrase, marquant ainsi une avancée significative dans la capacité de l'IA à se fondre dans la réalité. Produire des vidéos sans acteur ni décor n'est plus réservé à Pixar ou Disney, tout un chacun peut s'y mettre.

Cette nuit, OpenAI, la société derrière ChatGPT, a dévoilé Sora, un modèle texte-vidéo conçu pour simuler le monde physique en mouvement à partir d'une phrase, marquant ainsi une avancée significative dans la capacité de l'IA à se fondre dans la réalité. Produire des vidéos sans acteur ni décor n'est plus réservé à Pixar ou Disney, tout un chacun peut s'y mettre.

Mise à jour 09/12 : OpenAI lance Sora aujourd'hui pour le grand public. Une information dévoilée par le célèbre youtubeur Marques Brownlee alias MKBHD qui avait déjà accès au service depuis plusieurs semaines en tant que bêta-testeur. Malheureusement, l'Europe n'est pas concernée pour le moment.

Mise à jour 28/02 :Cette fois, c'est la bonne, Sora est disponible chez nous en Europe. Attention, seuls les abonnés payants ont pour le moment accès à ce service. Tout le monde devrait pouvoir en profiter d'ici quelques mois.

Sora est une claque

En fait, il suffit d'écrire un texte pour que la vidéo soit créée par l'IA, à l'instar de DALL-E pour la génération d'images, mais cette fois pour les vidéos. Ce n'est pas la première intelligence artificielle à le proposer, Runway peut par exemple animer une image avec un texte, mais c'est clairement d'un tout autre niveau.

© OpenAI Sora

Sora peut réaliser des vidéos d'une durée maximale d'une minute, en maintenant une qualité visuelle élevée et en respectant scrupuleusement les instructions de l'utilisateur. Pour tout artiste, cinéaste ou étudiant qui doit créer une vidéo, cela ouvre de nombreuses possibilités. Le gain de temps est considérable, ce qui permet de tester ses idées en un claquement de doigt, avant d'approfondir une fois le choix fait en revenant aux méthodes traditionnelles. Les entrepreneurs voulant par exemple faire un POC y trouveront un allié de poids.

OpenAI précise que Sora a été mis à la disposition des membres de l'équipe rouge (Red Team par opposition à Blue Team) pour évaluer les dommages ou les risques potentiels, ainsi qu'à un groupe sélectionné de professionnels de la création pour obtenir un retour d'information sur son utilité dans le cadre professionnel. OpenAI prévoit d'affiner Sora sur la base de ces commentaires, afin de s'assurer qu'il répond efficacement aux besoins de ses utilisateurs. Les vidéos de démonstration sont en tout bluffantes, pour ne pas dire surréalistes.

Sora peut créer des scènes complexes avec des détails hallucinants comprenant plusieurs personnes, des mouvements naturels et des environnements criants de vérité. Par exemple, Sora peut créer des vidéos représentant une femme élégante marchant dans une rue de Tokyo éclairée au néon, des mammouths laineux géants dans une prairie enneigée, un musée plein de tableaux ou encore une bande-annonce de film présentant les aventures d'un homme de l'espace.

C’est bluffant 😳 https://t.co/GW1M6Jh8sY

— iPhoneSoft.fr (@iphonesoft_fr) February 15, 2024

OpenAI just announced Sora, their new AI video model!

— Proper 🧐 (@ProperPrompter) February 15, 2024

If it wasn't true before it is now, AI video is taking over in 2024.

9 insane examples from the new model:

1) pic.twitter.com/E97oBlTDYv

All of these UNBELIEVABLE videos were created using Sora, the new AI model from OpenAI

— GREG ISENBERG (@gregisenberg) February 15, 2024

Watch each one and see how it makes you feel...

I don't think it's crazy for me to say this going to shift Hollywood, social apps and media forever

Video #1

Prompt: The camera directly faces… pic.twitter.com/NJfphtGbWb

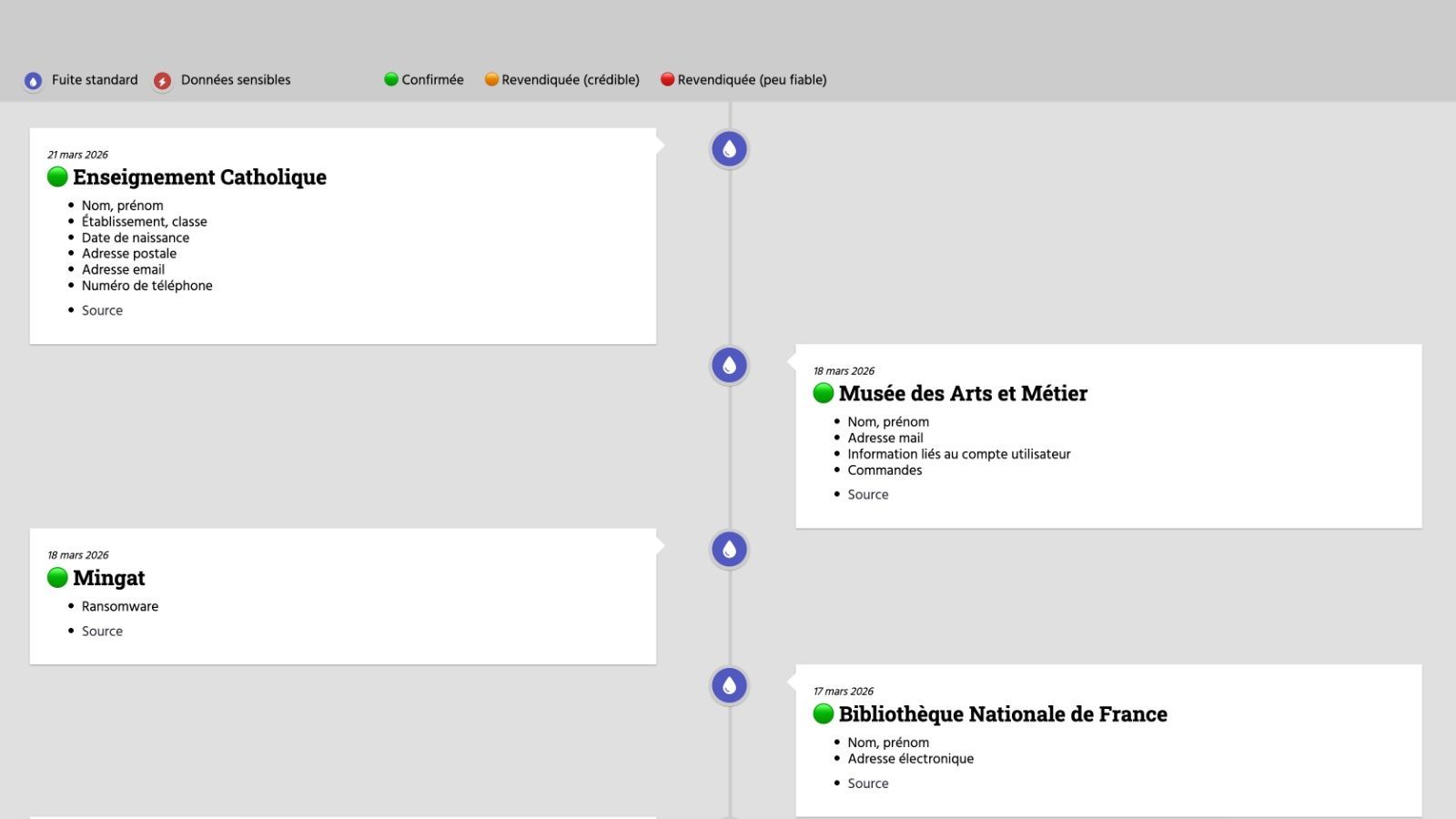

Les limites de l'IA Sora

En tant que première version, Sora présente évidemment plusieurs limites. L'IA peut s'emmêler les pinceaux sur la simulation de la physique de scènes complexes et la compréhension de scénarios spécifiques de cause à effet. Selon OpenAI, Sora peut également confondre des détails spatiaux et éprouver des difficultés à décrire des événements précis dans le temps.

Du côté de la sécurité, OpenAI travaille avec des experts du domaine pour tester le modèle afin de détecter les informations erronées, les contenus haineux et les préjugés, ainsi que pour développer des outils permettant de détecter les contenus trompeurs. L'entreprise prévoit également d'intégrer les métadonnées C2PA dans les prochaines versions afin de garantir l'authenticité du contenu. Les deepfakes sont déjà compliqués à repérer, alors avec Sora...

D'autres fonctionnalités utiles

Sora a été créé sur la base de recherches antérieures des modèles DALL-E et GPT. La fonction peut également transformer une image et en faire une vidéo, comme Runway. Les vidéos existantes peuvent également être prolongées ou les images manquantes complétées. Assez incroyable.

En outre, sachez qu'Apple y travaille aussi avec Keyframer, mais nous n'avons pas encore eu de démonstration à son sujet. La WWDC 24 devrait être très intéressante de ce point de vue...