Alexa connaîtra bientôt vos sentiments

Gabriel Tjappa

Gabriel Tjappa- Il y a 7 ans (Màj il y a 7 ans)

- 💬 3 coms

- 🔈 Écouter

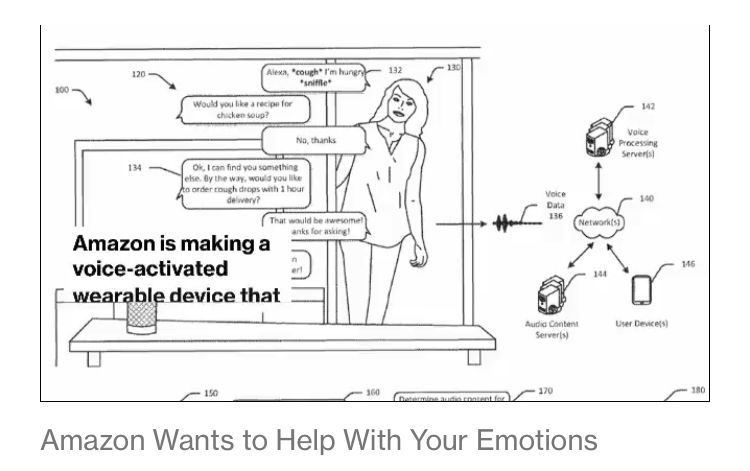

![]() L’équipe Amazon Alexa expérimente actuellement des moyens pour détecter des émotions comme le bonheur et la tristesse, travail qui a été publié dans le cadre d’une étude réalisée plus tôt cette année. L’assistant virtuel concurrent de Siri d’Apple semble prendre une nouvelle longueur d’avance.

L’équipe Amazon Alexa expérimente actuellement des moyens pour détecter des émotions comme le bonheur et la tristesse, travail qui a été publié dans le cadre d’une étude réalisée plus tôt cette année. L’assistant virtuel concurrent de Siri d’Apple semble prendre une nouvelle longueur d’avance.

Machine learning pour comprendre les sentiments

D’après Bloomberg, Amazon travaille sur un dispositif portable de détection des émotions que les gens pourraient utiliser pour comprendre les sentiments de ceux qui les entourent. Le projet d’intelligence émotionnelle d’Alexa est en chantier depuis des années.

L’émotion peut être décrite directement par des valeurs numériques suivant trois dimensions : la valence, qui parle de la positivité [ou de la négativité] de l’émotion, l’activation, qui est l’énergie de l’émotion, puis la dominance, qui est l’impact dominant de l'émotion, a déclaré Wang.

L’approche multimodale de l’œuvre analyse à la fois les signaux acoustiques et lexicaux de l’audio pour détecter les émotions. L’acoustique examine les propriétés sonores et vocales de la parole et le lexique s’occupe de la séquence de mots, a expliqué Viktor Rozgic, scientifique principal en sciences appliquées chez Amazon Alexa.

Les caractéristiques acoustiques décrivent plus ou moins le style de la façon dont vous vous exprimez, et les caractéristiques lexicales décrivent le contenu. Ils sont tous deux importants pour la connexion émotionnelle. Ainsi, une fois les caractéristiques extraites, elles sont intégrées dans un modèle. Dans notre cas, il s'agira d'architectures de réseau de neurones différentes, puis nous ferons une prédiction, dans ce cas-ci colère, tristesse et état émotionnel neutre, a-t-il déclaré.

Un des articles récemment publié par Amazon, intitulé « Amélioration de la classification des émotions grâce à l’inférence des variables latentes », explique une approche permettant d’obtenir de légères améliorations de la valence afin de prévoir les émotions.

Comment ça marche la détection des sentiments ?

Pour extraire les émotions des enregistrements audio, les interactions humaines dans les enregistrements vocaux sont mappées sur une séquence de vecteurs spectraux, transmises à un réseau de neurones récurrents, puis utilisées comme classifieur pour prédire la colère, le bonheur, la tristesse et les états neutres.

« Nous transmettons les caractéristiques acoustiques à l’encodeur, qui les transforme en une représentation dimensionnelle inférieure à partir de laquelle le décodeur reconstitue les caractéristiques audio originales et prédit également l’état émotionnel ». Dans ce cas, il s’agit d’une valence à trois niveaux : négatif, neutre et positif, et le rôle de l’apprentissage contradictoire est de régulariser le processus d’apprentissage de manière spécifique.

L'évolution d’analyse de l'intelligence artificielle

Les progrès en matière d'apprentissage automatique, de traitement du signal et de classificateurs tels que les machines à vecteurs de support ont également permis de faire avancer les travaux. La technologie peut également être utilisée pour aider les gens à mieux comprendre les émotions des autres.

Il y a beaucoup d’ambiguïté dans cet espace, les données et l’interprétation, cela rend les algorithmes d’apprentissage automatique très précis et extrêmement complexes, a déclaré Wang.

Pour l’heure, l’équipe travaille d’arrache-pied pour améliorer ce produit, grâce à ces informations nous sommes maintenant sûr que l’intelligence artificielle occupera une place fondamentale dans nos vies.

Télécharger l'app gratuite Amazon Alexa