Apple est accusé d'enregistrements accidentels avec Siri dans une plainte (US)

Julien Russo

Julien Russo- Il y a 5 ans

- 💬 5 coms

- 🔈 Écouter

![]() On ne s'en rend pas compte, mais aujourd'hui une grande entreprise peut facilement entendre ce qui se passe chez vous. Nous avons le HomePod, l'iPhone, le Mac, la Siri Remote de l'Apple TV ou encore l'Apple Watch au poignet. Tous ces appareils possèdent des micros qui peuvent facilement servir pour vous espionner !

On ne s'en rend pas compte, mais aujourd'hui une grande entreprise peut facilement entendre ce qui se passe chez vous. Nous avons le HomePod, l'iPhone, le Mac, la Siri Remote de l'Apple TV ou encore l'Apple Watch au poignet. Tous ces appareils possèdent des micros qui peuvent facilement servir pour vous espionner !

Apple va devoir faire face à un recours collectif

La firme de Cupertino accorde beaucoup d'importance à la confidentialité, cependant la perte de crédibilité est énorme quand une poursuite judiciaire se déclenche à travers un recours collectif de dizaines de clients mécontents.

C'est justement ce qui se passe aux États-Unis, un groupe de clients affirme que l'assistant vocal d'Apple capture des enregistrements vocaux via des activations accidentelles.

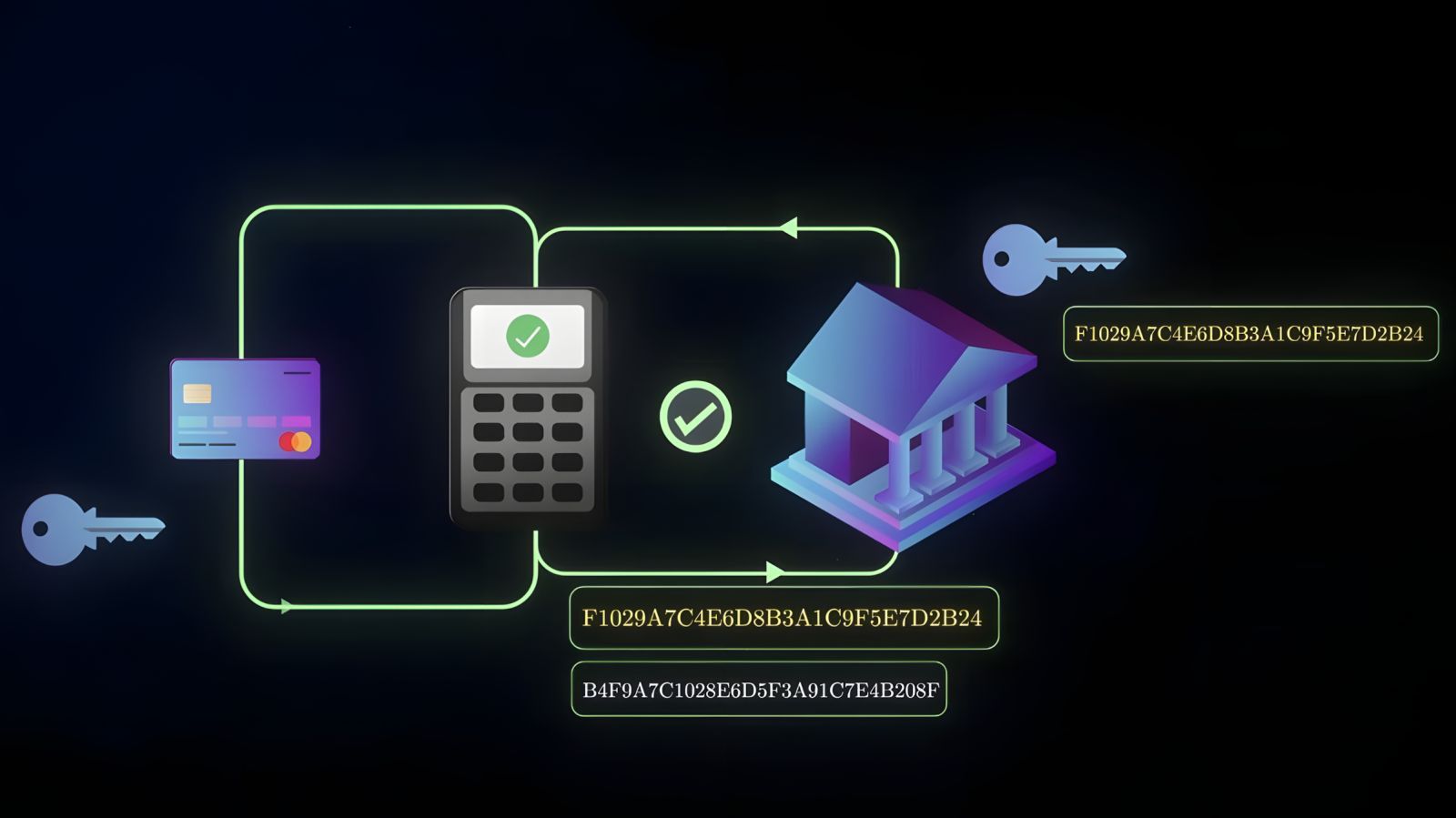

Les plaignants accusent Apple de régulièrement enregistrer des conversations privées et de vendre les données obtenues à des entreprises tierces. Dans la plainte, un utilisateur explique que l'une de ses conversations avec son médecin au sujet d'un traitement chirurgical a provoqué l'affichage de publicités ciblées lors de l'utilisation de son iPhone.

Les publicités mettaient en avant des traitements concurrents, alors que le principal intéressé n'avait jamais fait de recherche Google.

Jeffrey White est le juge américain qui sera en charge de l'affaire et voici ce qu'il déclare après avoir attentivement lu la plainte déposée et entendu Apple :

Apple reproche aux plaignants de ne pas avoir allégué le contenu de leurs communications, mais le cadre privé à lui seul suffit à montrer une attente raisonnable en matière de vie privée

Même si Apple rêvait que ce recours collectif n'aboutisse pas, il aura finalement lieu. Le juge White a donné son feu vert pour que le recours collectif poursuive Apple en s'appuyant sur une violation de la loi fédérale sur l'écoute électronique ainsi qu'une infraction à la loi californienne sur la protection de la vie privée.

Ce n'est pas la première fois qu'Apple se fait prendre la "main dans le sac" sur les écoutes abusives avec son assistant vocal Siri. On se souvient d'une affaire de 2019 où plusieurs anciens employés (chargés d'écouter les enregistrements de Siri pour l'améliorer) avaient déclaré recevoir un peu trop d'enregistrements accidentels à traiter !

À l'époque, ils avaient expliqué avoir déjà entendu des conversations parfois très intimes comme des conversations médicales, des conversations "hot", des transactions criminelles ou encore des conversations sur le lieu professionnel qui ne doivent normalement pas sortir de l'entreprise.

Les enregistrements accidentels se réalisent dans deux situations : quand une phrase se rapproche un peu trop de "Dis Siri" ou quand l'utilisateur appuie par erreur sur le bouton qui déclenche Siri (dans la poche par exemple en marchant).

À la suite de cette affaire, Apple avait décidé de suspendre la collaboration avec l'entreprise sous-traitante chargée d'améliorer Siri, dans une mise à jour logicielle, le géant californien avait inclus une option permettant de désactiver le partage des données de vos interactions avec Siri.

On ne peut pas dire qu'Apple est resté sans rien faire, l'entreprise a rapidement réagi, ce qui lui permettra peut-être de s'en sortir sans être condamné dans cette nouvelle affaire.

Source